フェイクニュースやデマ、それを拡散し確信を強化するさまざまな仕掛け。ネットの信頼を揺るがす問題が日本でも顕在化している。悪貨が良貨を駆逐するよう、情報空間そのものの信頼性と価値が毀損されかねない。

こうした現状を改善すべく、スマートフォン向けニュースアプリのスマートニュース社などが情報の事実確認、ファクトチェック支援にかかる技術の実証実験を行うと発表した。ニュースを取り扱うメディアを運営はしているが、ジャーナリズム経験者のほとんどいないテック企業がなぜ、ファクトチェックにコミットするのか。

東北大学や研究者組織(FIJ)も参加

ファクトチェックの技術実証実験はスマートニュースのほか東北大学、研究者らのファクトチェック連合組織「ファクトチェック・イニシアティブ・ジャパン(FIJ)の三者で行う。ニュース記事へのコメントや反応などを自然言語処理、機械学習で解析。フェイクかどうか、人間がチェックすべき記事に振り分けデータベース(DB)化して、人間がより効率的かつ良い営みができる仕組みづくりを目指す。

本年度中に実証実験を重ね、2018年夏には実用化の予定。11月に東京・表参道で開かれたスマートニュース社の「メディアパートナーミーティング2017」で、東北大学大学院情報科学研究科の乾健太郎教授らが発表した。

2017年10月の総選挙では、日本初のファクトチェックプロジェクトが行われ、BuzzFeedやJapan-In-depth、ニュースのタネなどが参加。主に政治家の発言に関するニュース記事を対象に計22本のファクトチェック記事が公開された。FIJはファクトチェックを①事実に関する言明の②真偽・正確性を調査・検証し③証拠等の判断材料を提供する-ことと定義した。この作業には経験を積んだ人間による高度な判断が必要となる。さらにどの記事を対象にするのか検索し選び出す作業や、事実確認、記事化、公開まですべて人手で行われた。

乾教授によると、例えばTwitterでファクトチェックの端緒になり得るツイートは1000件に1件程度。こうした端緒を探す作業を人力で行うには限界がある。そこで「記事にどんなコメントが書かれているのか、どんな反応があるかを自然言語処理で解析して振り分ける。記事が蓄積されていけば、機械学習によってどういう記事でどういうコメントあれば人間がファクトチェックをするべきか、ある種ルールが分かってくる。オープンなデータベースで、ファクトチェックができる人が集まる大きなフォーラムをつくるのが目的。使いやすいインターフェースを準備したい。記事を評価するのはあくまで人間で、作業を技術で支援するのが目的」と述べた。当面は対象をネット上の媒体社のニュース記事とし「対象は広ければ広い方が良いと考えている。政治家の発言などへの展開は今後、検討する」という。

スマートニュース社は、このデータベースのシステム運用、技術支援、東北大が開発するアルゴリズムの実装などを行う。フェイクニュースでは、デマ・偽情報の拡散に訂正情報が追いつかないことも問題のひとつ。同社の藤村厚夫執行役委員は「総選挙のように期間が2週間しかない場合、フェイクニュースの拡散に追いつく仕組みをつくるためにも、テックを使う必要がある。そのためのオープンなスキーム、DBを整備することが重要と考えている」と述べた。

なぜスマートニュースなのか

「広告主とジャーナリストの利害は必ずしも一致しないが、フェイクニュースについては、利害はまったく一致している。すべては、やはり信頼の問題であり、フェイスブックなどプラットフォームはいじめ、ヘイト、陰謀、フェイクニュースの巣窟になってしまった」。

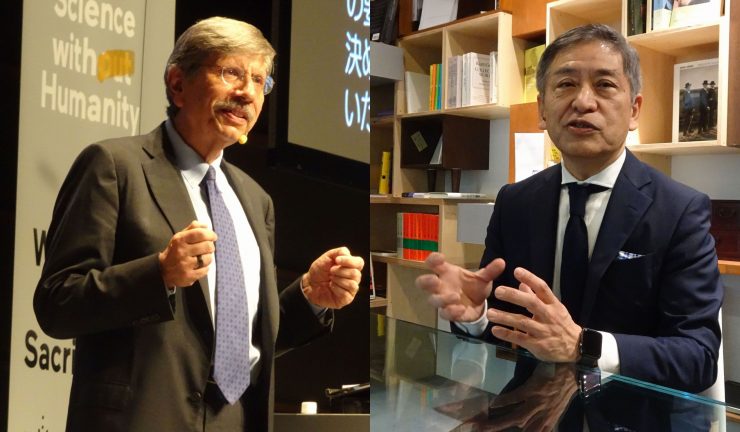

米スマートニュースのヴァイス・プレジデント・コンテンツ担当、リッチ・ジャロスロフスキー氏は10月、日本での講演でこう述べた(アドテック東京2017基調講演「デジタルメディアが直面する課題と機会~フェイクニュースに抗うために」。ジャロスロフスキー氏は、ウォール・ストリート・ジャーナル紙の政治記者、ブルームバーグのエグゼクティブ・エディターなどを務め、国際的なデジタルジャーナリズム組織Online News Association(ONA)の創設者で初代プレジデントを務めた人物。

ジャロスロフスキー氏によれば、米国では日本で想像する以上にフェイクニュースの問題は深刻だ。ワシントンのピザ店が小児性愛と児童買春の拠点となりヒラリー・クリントンが関与している-というフェイクを発端に、ピザ店で男が発砲する「ピザゲート事件」が起きている。また、10月のラスベガス銃乱射事件では、無関係の人物を犯人視するニュース風記事がグーグルの検索上位に表示され、SNSで拡散されたという。

ジャロスロフスキー氏はグレシャムの法則「悪貨は良貨を駆逐する」に倣い「悪い情報は良い情報を駆逐する」とフェイクニュース問題の深刻さを訴え、日本でもいずれ避けられない問題であると指摘した。

フェイスブックなどフェイク拡散の舞台はパーソナライズ化され、ユーザーにとって「心地よい空間」が演出されている。その結果生じたのは、ユーザーが嗜好に合う情報に囲まれるフィルターバブルや、同じような意見が反響しあい先鋭化するエコーチェンバーと言われる課題だ。

SNSは人々のコミュニケーションを活性化するために、いかに心地よいユーザー体験を提供するかに重きを置く。人々が黙り込むようなシリアスなニュースよりも楽しく面白く、容易に参加できる話題が好まれる。あるいは、それがフェイクだとしても、ユーザーの政治的嗜好に合致するニュースやユーザーが共感し多幸感を覚える情報がパーソナライズ・アルゴリズムによってセットされる。ゆえにエコーチェンバーやフィルターバブルは、SNSが持つ蓋然性であるかもしれない。

一方で、ニュースアプリはニュースを扱う以上、信頼性や事実を基盤としなければならない。藤村氏はジャロフロフスキー氏がこう述べたことを覚えている。

「ジャーナリストは居心地の悪さを発信するものだ。世間が浮かれている時にはシニカルなこと、打ちひしがれている時には明るい話題を。ひねくれた立場にあることが、ジャーナリストの重要な仕事。世界には多様な事件、事象があって、それらを居ながらに体験することには、非常な価値がある」。「居心地を悪くする情報も提供することがジャーナリストのミッションであれば、そうした情報を積極的に取り上げるのは、(スマートニュースのような)ニュースアグリゲーターのミッションでもある」と藤村氏は語る。

幅広い見解を表示する工夫

スマートニュースは以前からUS版にPolitical balancing algo-rithm(PBA)を搭載している。トップ画面では、ユーザーの信条とは異なるだろう媒体社のニュースを「さりげなく」表示する仕掛けだ。FOXニュースに共感する人にも、ニューヨーク・タイムズの記事が表示されるし、その逆のこともある。

社会分断が進んだ米国では、保守リベラルを問わず自身の信条と相容れないニュースが表示されることへのクレームが強いという。そこで開発されたのがPBAだった。さらにアルゴリズムだけでなく、デザインにも配慮している。媒体社名が際立つと、FOXが嫌いな人は最初からFOXのニュースを読まなくなる。だから、媒体社名も目立たなくする。アグリゲーターとして、媒体社のブランドがないように見せることへ批判もあるが、ブランドに気づいていない人との出会いを作ることで果たせるミッションもある。

分断傾向は、日本でも強くなっている。日本版でユーザーの立場の違いが特に顕在化するのは日韓、日中問題を扱う国際カテゴリだ。ユーザー・データだけから判断すれば、分断した方が「心地よい」空間になるとの欲求は見出すことができるという。日本版には、PBAのようなアルゴリズムは搭載されていなが、CNNやBBCなど海外の媒体社の配信記事を積極的に取り込むことによって、ユーザーが日本から見た日韓・日中関係だけでない視点で多様なニュースに触れられるようにするなど試行錯誤が続く。

良いメディア環境とは何か

コンテンツが分散化・細分化されバラ売りされるネットでは、コストがかかり儲かりにくいニュースコンテンツは生み出されにくい。例えば、SEOハックでクローズアップされた「医療・健康」分野は、媒体社が少なく良質なコンテンツが少ないため、スマートニュースもチャンネルをつくれていない。そこで藤村氏は「ビジネスになりにくく、黙っていては供給が増えないジャンルのニュースを生み出される仕組みをサポートできないか」とも考えている。

またニュースコンテンツの評価も課題だ。即時的に役立った、拡散したといった価値だけではなく、小説や映画と同じく、10年後に何かの気づきにつながることで価値を持つニュースもあるかもしれない。「個人的には、じっくりと自分の中で熟成され、深く長い時間をかけて行動に影響を及ぼすようなニュースコンテンツも、テックが評価できるようにしたい」という。

ニュースを集め配信するアグリゲーターであるスマートニューにとって、多様な視点と発見を提供する良質で信頼できるニュースが維持・供給されることは生命線。ニュースへの信頼、多様性を守るという極めてジャーナリスティックな問題意識は、同社の「世界中の良質な情報を必要な人に送り届ける」というミッションに欠かせないことであるようだ。