拡張現実×視覚障害 「計算眼科学」がもたらす視覚体験とは

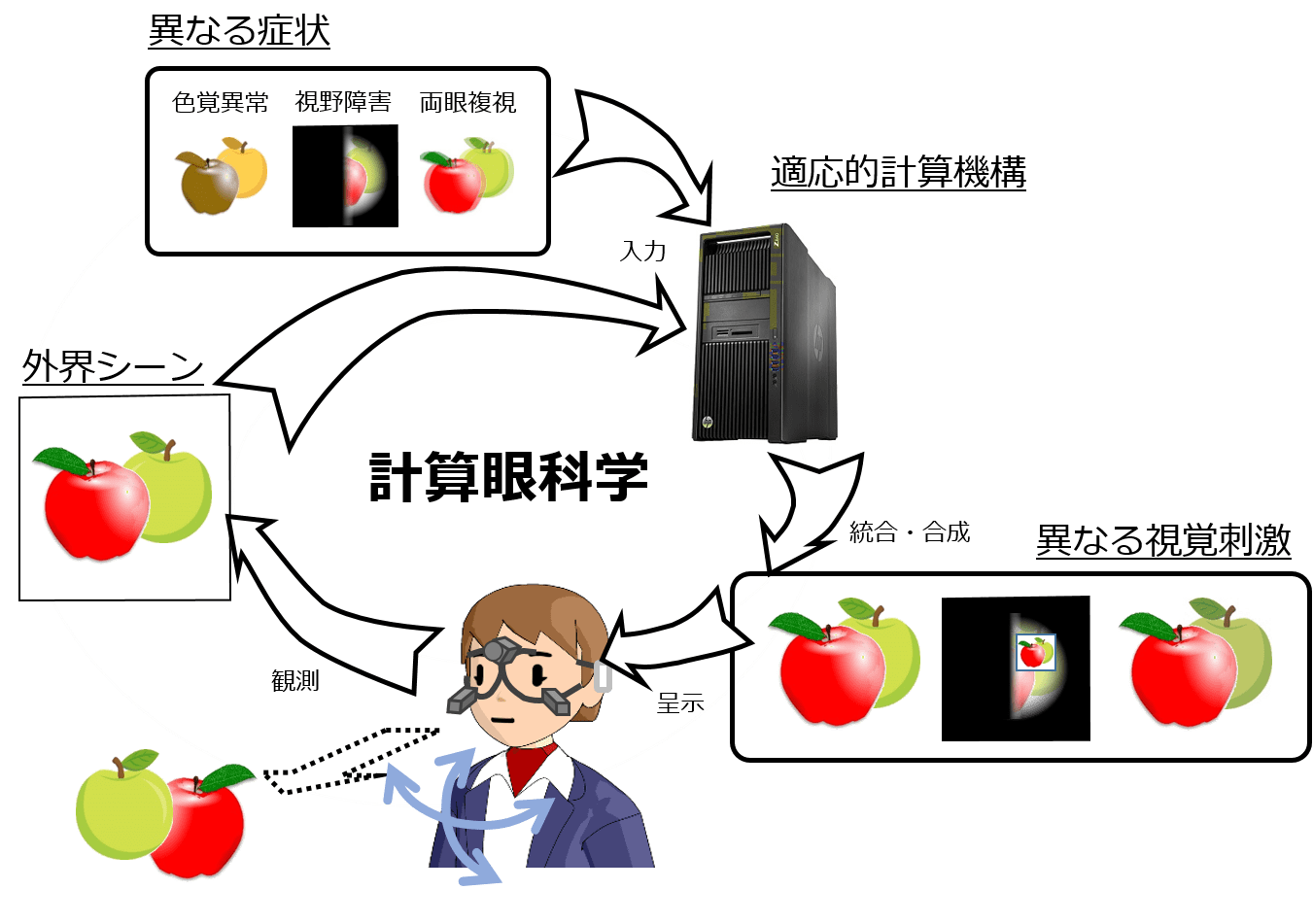

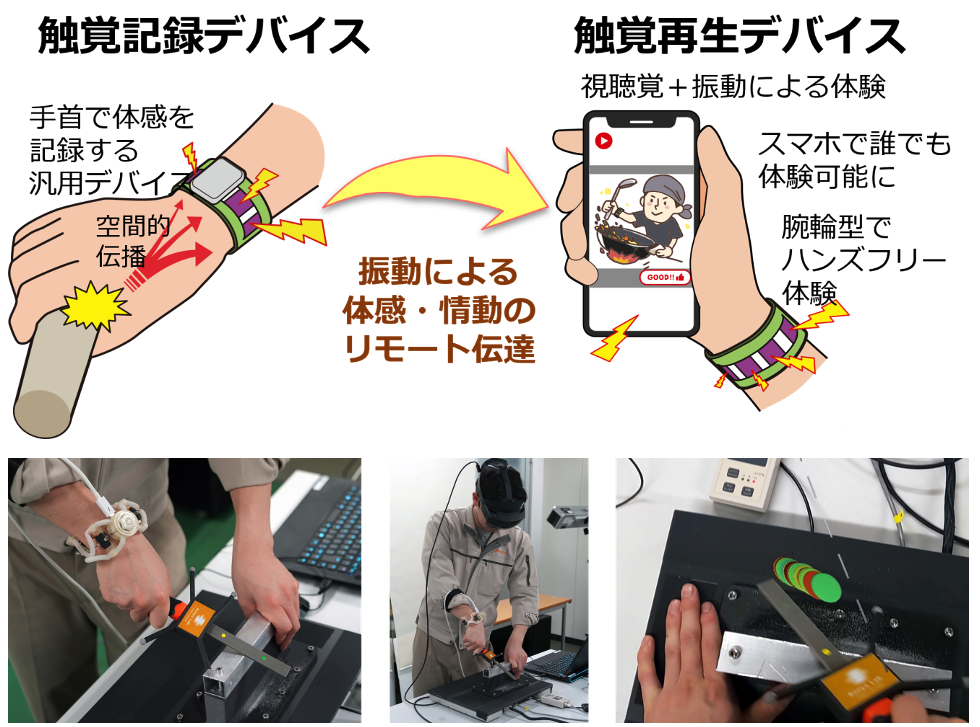

「計算眼科学」の概念図 (画像提供:茅研究室)

VR/AR技術の発達やヘッドマウントディスプレイ(以下、HMD)、スマートグラスなどの進化は、これまで得られなかったさまざまな視覚体験をもたらしてくれる。近年、こうしたテクノロジーを、日常生活に何らかの支障を抱える視覚障害者の課題解決に活用しようという動きが世界中で見られるようになった。

山梨大学工学部コンピューター理工学科の茅 暁陽(まお・しやおやん)教授が、慶應義塾大学情報工学科の藤代一成教授らと進めている「計算眼科学(Computational Ophthalmology)」もそうした研究のひとつだ。

視覚障害にはさまざまな症状があるが、一般に矯正用メガネなどを使って補正することが多い。こうした矯正用メガネは一度作ってしまうと簡単には機能を変えることができない。ところが視覚障害の症状は、疲れが溜まると重くなるなど日々の体調によって微妙に変化する。こうした変化に対して、VR/ARやAI(人工知能)を使って適宜最適な補正を提供しようというのが「計算眼科学」の狙いだ。

現在、茅教授らは「視野障害」「色覚異常」「両眼複視」「歪視(わいし)」の4つを対象に研究を進めている(※)。視覚障害者の生活をどのように改善しようとしているのか。また、どのような成果が出ているのか。茅教授に聞いた。

※「視野障害」「色覚異常」「両眼複視」の研究は、文部科学省「科学研究費助成事業 基盤研究(A)」(2017年〜2022年)の助成対象。「歪視」の研究は、「科学研究費助成事業 挑戦的研究(開拓)」(2019年〜2024年)の助成対象。

目の機能を“計算技術”と“拡張現実”で増強

「計算眼科学」の大まかな仕組み(冒頭画像を参照)は次のようになっている。

まず利用者はスマートグラスやHMDなどのデバイスを装着する。そこには外向きのセンサー(カメラ)が搭載され、その時々の状況を捉える。さらに内向きのセンサー(視線追跡装置)も搭載され、利用者が何を見ようとしているのか、どういう情報を必要としているのかを捉える。

次に2つのセンサーから得た情報をコンピューターに入力する。ここでAIに画像解析させるなどした後、利用者が必要な補正情報をディスプレイ上に表示する流れになっている。

「もともと視覚障害者の多くは、機能を完全に失っているわけではありません。何かしらの機能は持っているが、その一部が欠けている、あるいは障害を負っている。そこをコンピューターの計算技術や拡張現実技術を使って最大限に補正し、増強してあげようというのが私たちの狙いです」(茅教授)

ちなみに、茅教授らが最終的に目指すのは、「視覚障害者本人が、その時々の状態(症状)に合わせて補正機器のチューニングができるようにする」世界だ。

「今まで(機器調整のための)検査は病院に行かないとできませんでした。私たちが目指すのは、視覚障害のある人が病院に行かずとも、自分のスマートフォンやタブレットでアプリを起動し、その日の状態をチェックすると、それがそのまま補正機器の調整に直結すること。これにより視覚障害者の社会生活の質を改善しようというのが本プロジェクトのゴールです」

「色覚異常」「歪視」の課題をどう解決するのか

では具合的に、視覚障害者が抱える課題を技術的にはどう解決しているのだろうか。今回は大きな研究成果が出ているという「色覚異常」と「歪視(わいし)」について聞いた。

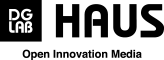

人の網膜上には色を知覚する錐体細胞があり、赤、緑、青の波長に反応するが、これが何らかの原因で反応しにくくなり、赤と緑を識別しづらくなることがある。これが「色覚異常」だ。

色覚異常に対しては、画像処理で緑と赤のコントラストを強めるなどしてディスプレイに表示し、色を区別しやすくする手法が考案されている。

「ただし、視覚障害者がもともと見ている色を変え過ぎてしまうと違和感が出てしまいます。そこで、なるべく本人が普段見ている景色と違わない、自然さを保ちながら区別できるような画像を表示してあげるよう調整しています」(茅教授)

この手法を色覚異常がある人に体験してもらったところ、色の区別がしやすくなったという。

しかし当初の手法では、画像内の全ての色をAIで解析し最適化していたため、処理に時間がかかっていた。そこで、ひとつひとつの色ではなく、全体でひとつの最適解を求め画像処理する新手法を考案。これにより現在では「リアルタイムに画像処理できるようになった」と茅教授は自信をのぞかせる。

ちなみに、現時点ではスマートグラスなどウェアラブル端末で処理した画像を見ることはできない。利用者が見ている景色と処理済みの画像の位置を合わせて表示するのが難しいためだ。しかし、スマートフォンで表示するアプリ上であれば、「今すぐにでも実用化することが可能」とのこと。

* * *

目の網膜の中央部分(黄斑 : おうはん)は、加齢などにより、腫れたりむくんだりして、細胞の並びが歪むことがある。これにより物が歪んで見えてしまうのが「歪視」だ。

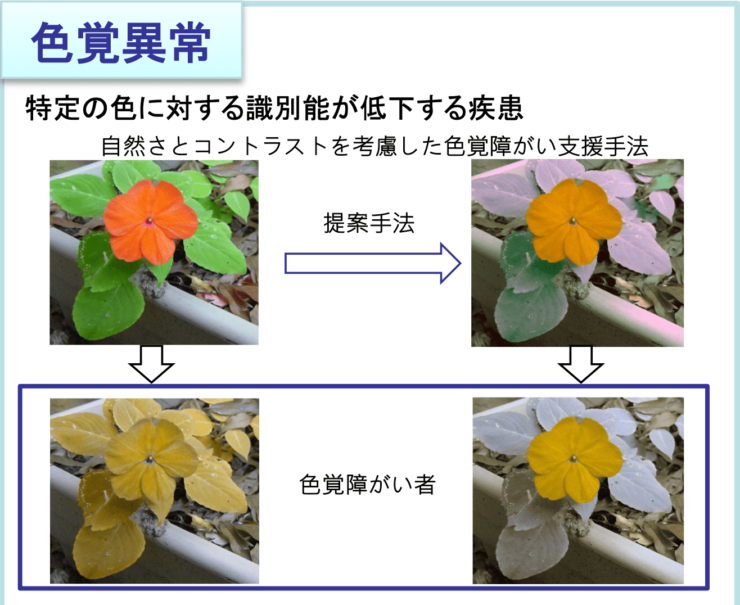

実は歪視の患者が「どれくらい歪んで見えるか」を正確に計測するのは難しい。そのため、医者と患者のコミュニケーションが取りづらく、手術をしても効果がわかりづらいなどの問題がある。

このため眼科医から「まずは歪視の患者がどう見えているのかを可視化する技術がほしい」と強い要望が寄せられていたという。

そこで茅教授がまず取り組んだのが、以下の検査手法の開発だ。

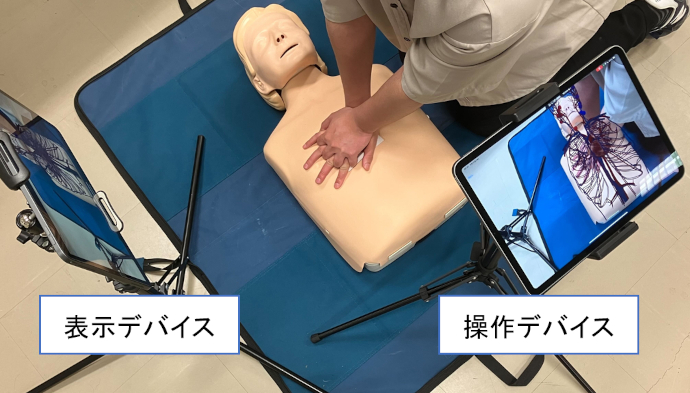

まずパソコンのモニターに、マウスで引っぱることで自由に変形できる直線を表示する。歪視の患者にとっては歪んで見えるため、マウスを操作し線の歪みを補正してもらう。すると、健常者から見ると線が歪んだ線ができあがる。この歪みを反転すると、そのまま歪視の症状を可視化したものとなる。

「患者本人にとってまっすぐ見える図は、実は反対方向に曲がっています。これを利用することで症状を可視化できます。私たちはこの検査手法で特許を取得しました」

歪視の改善は、この検査手法で得た歪みデータをコンピューターに取り込み、逆方向に補正した画像を表示することで可能となる。実際に被験者に試してもらったところ、「線がまっすぐ見えるようになった」など、着実に研究成果が出ているとのことだ。

* * *

今後の展望をたずねると、研究開発した技術や手法を実用化し、できるだけ早く視覚障害者の支援につなげたいと茅教授は力強く答えた。そのためにも、コラボレーションしたい企業などがいれば「ぜひ一緒に取り組みたい」と話す。

テクノロジーを視覚障害者の課題解決に結びつける動きが、今後さらに加速することを期待したい。

ストックオプション(SO)は「導入」で終わらない。Boost Healthが挑む、社員の貢献を形にする継続的な文化づくり

ストックオプション(SO)は「導入」で終わらない。Boost Healthが挑む、社員の貢献を形にする継続的な文化づくり